Confronto tra sensori CCD e CMOS: quale è il migliore per l'imaging?

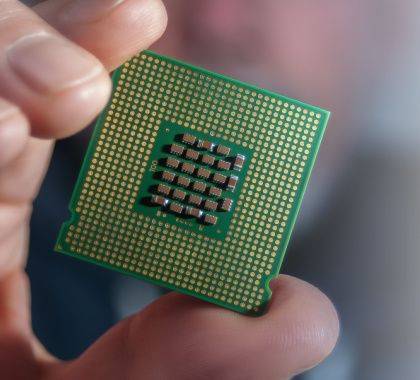

Ogni progetto per applicazioni di imaging, visione artificiale e fotonica necessiterà di qualche tipo di assemblaggio ottico e sensore per funzionare correttamente. Il tuo prossimo sistema ottico incorporerà una vasta gamma di componenti ottici, e i sensori di imaging sono il ponte tra il mondo ottico ed elettronico.

La scelta giudiziosa del sensore richiede di considerare una serie di fattori. Alcuni di questi fattori sono relativi al tempo di risposta, al formato, alla risoluzione e all'applicazione. La scelta tra un sensore CCD e CMOS può essere difficile, ma determinerà quanto velocemente il tuo sistema può risolvere le immagini evitando la saturazione. Se hai bisogno di lavorare al di fuori del range visibile, dovrai considerare materiali alternativi al Si per un'imaging efficace. In alcune applicazioni, potrebbe essere più sensato lavorare con un array di fotodiodi. Ecco ciò che devi sapere su questi diversi tipi di sensori e come scegliere il componente giusto per la tua applicazione.

Requisiti del Sensore e del Sistema di Imaging

Ogni sistema di imaging dovrebbe essere progettato per soddisfare alcuni requisiti particolari, e molti di questi si concentrano sulla scelta del sensore ottico. Per iniziare, considera il materiale di cui hai bisogno per la tua gamma di lunghezze d'onda, poi confronta aspetti come risoluzione, tempo di risposta e linearità.

Materiali Attivi e Gamma di Rilevamento

Il materiale attivo utilizzato nel tuo sensore determinerà la gamma di lunghezze d'onda sensibili, le perdite di coda di banda e la sensibilità alla temperatura. Potresti lavorare nell'infrarosso, nel visibile o nell'UV, a seconda della tua applicazione. Per i sistemi di telecamere, vorrai una sensibilità in tutto l'intervallo visibile, a meno che tu non stia lavorando su un sistema di imaging termico. Per applicazioni di imaging specializzate, come l'imaging a fluorescenza, potresti lavorare in un intervallo che va dall'IR all'UV.

Alcuni materiali attivi sono ancora in fase di ricerca, mentre alcuni sono già disponibili come componenti commercializzati. Se stai confrontando componenti di sensori CCD vs. CMOS, il materiale attivo è un buon punto di partenza quando selezioni i sensori candidati.

- Si: Questo è il materiale più comunemente utilizzato nei sensori di imaging. Il suo bandgap indiretto di 1.1 eV (~1100 nm di bordo di assorbimento) lo rende più adatto per lunghezze d'onda visibili e NIR.

- InGaAs: Questo materiale III-V offre rilevamento IR fino a ~2600 nm. La sua bassa capacità di giunzione di <1 nF rende i sensori InGaAs ideali per applicazioni alle lunghezze d'onda SMF (1310 e 1550 nm). La sintonizzazione si ottiene modificando la stechiometria di In(1-x)GaxAs. I sensori CCD InGaAs sono disponibili sul mercato da fornitori di fotonica, e aziende come IBM hanno dimostrato la compatibilità di InGaAs con i processi CMOS.

- Ge: Questo materiale è meno comune nelle telecamere e nei sensori CCD a causa del suo costo più elevato rispetto al Si, e i sensori CMOS in Ge puro e SiGe sono ancora un argomento di ricerca molto attivo.

Ci sono altri materiali disponibili per l'uso come sensori di immagine, sebbene questi siano normalmente utilizzati in fotodiodi e non siano fortemente commercializzati. Se lavori nel campo visibile, Si è la strada da seguire poiché avrai sensibilità a lunghezze d'onda da ~400 nm a ~1050 nm. Se lavori in profondità nella gamma IR, vorrai utilizzare InGaAs. I sensori CCD e CMOS Si possono essere utilizzati per lunghezze d'onda UV, ma solo quando il sensore ha un trattamento superficiale speciale per prevenire l'ablazione.

I filtri colorati sono spesso utilizzati sui sensori CCD e CMOS per formare immagini monocromatiche o filtrare lunghezze d'onda specifiche. È comune vedere CCD e sensori CMOS con un filtro in vetro a taglio netto o un film sottile per rimuovere le lunghezze d'onda IR.

Frequenza dei fotogrammi, Risoluzione e Rumore

La frequenza dei fotogrammi è determinata dal modo in cui i dati vengono letti dal rilevatore. Il rilevatore è composto da pixel discreti e i dati devono essere letti sequenzialmente dai pixel. Il metodo di lettura dei pixel determina la velocità con cui possono essere acquisite immagini o misurazioni. I sensori CMOS utilizzano uno schema di indirizzamento, dove il sensore e ogni pixel vengono letti individualmente. Al contrario, i CCD utilizzano un'esposizione globale e leggono ogni colonna di pixel con una coppia di registri di spostamento e un ADC.

Poiché questi sensori utilizzano metodi diversi per la lettura, vari moduli sensoriali richiedono componenti integrati diversi. Qui inizia il vero confronto poiché l'elettronica integrata determinerà le cifre di rumore, la linearità, la responsività, la profondità di colore (numero di colori che possono essere riprodotti) e il limite di rilevazione. La tabella sottostante mostra un breve confronto delle metriche di imaging importanti per i sensori CCD e CMOS.

| | CCD | CMOS | | ---------- | ---------- | ---------- | | Risoluzione | Fino a 100+ Megapixel | Fino a 100+ Megapixel | | Frequenza dei fotogrammi | Migliore per frequenze dei fotogrammi più basse | Migliore per frequenze dei fotogrammi più alte | | Figura di rumore | Pavimento di rumore più basso → Maggiore qualità dell'immagine | Pavimento di rumore più alto → Minore qualità dell'immagine | | Responsività e linearità | Responsività più bassa, gamma lineare più ampia | Responsività più alta, gamma lineare più bassa (satura in anticipo) | | Limite di rilevamento | Basso (più sensibile a bassa intensità) | Alto (meno sensibile a bassa intensità) | | Profondità del colore | Maggiore (16+ bit è tipico per CCD costosi) | Inferiore, sebbene stia diventando comparabile ai CCD (12-16 bit è tipico) |

Che dire dei fotodiodi?

Questa è una domanda giusta poiché gli array di fotodiodi possono essere utilizzati anche per raccogliere misurazioni dell'intensità in 1D o 2D. È importante notare che un fotodiodo è l'elemento attivo in un sensore CCD o CMOS; i tre tipi di sensori differiscono nel modo in cui i dati vengono letti dal dispositivo. Un array di fotodiodi è costruito con una configurazione a catodo comune, quindi i dati vengono letti dal dispositivo in parallelo. Questo rende i fotodiodi più veloci dei sensori CCD e CMOS. Tuttavia, l'uso di due fili per fotodiodo significa che avrai un piccolo numero di fotodiodi in un array; un fotodiodo di 100x100 pixel avrebbe 20.000 conduttori elettrici. Si può vedere come questo diventi rapidamente impraticabile.

L'altra opzione per l'uso dei fotodiodi è di effettuare una scansione raster meccanica del campo visivo con un diodo laser e raccogliere la luce riflessa/dispersa. Questo approccio di misurazione puntuale è utilizzato nei sistemi lidar per UAV e sistemi lidar automobilistici. È possibile formare un'immagine a bassa risoluzione in questo modo, dove il frame rate è limitato dalla velocità di scansione e dal tempo di mediazione. In questa applicazione, i sensori CCD e CMOS vincono ancora grazie alla loro maggiore risoluzione e frame rate simili.

Esempio di un'immagine lidar scansionata in raster per un veicolo autonomo. Notare l'autobus sul lato destro dell'immagine. Credito immagine: Baraja.

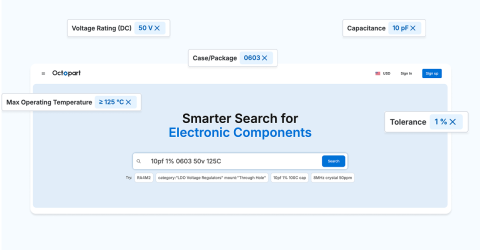

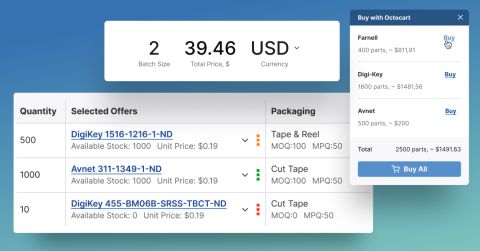

Trovare e valutare gli array di sensori CCD rispetto a CMOS sono passaggi critici nella progettazione di sistemi di imaging. Puoi trovare questi componenti e molti altri su Octopart.

Rimani aggiornato con i nostri ultimi articoli iscrivendoti alla nostra newsletter.