Componenti alla base degli odierni occhiali intelligenti e AR all'avanguardia

Dai uno sguardo all'interno degli innovativi occhiali intelligenti e AR per trovare microdisplay, guide d'onda, IMU, sensori di profondità, PMIC, raffreddamento a grafite e connettività compatta.

Gli occhiali stanno emergendo come il più nuovo formato di dispositivo personale, unendo moda, funzionalità e connettività in un unico pacchetto elegante. Secondo IDC, le spedizioni di occhiali intelligenti e di realtà aumentata (AR) dovrebbero crescere del 39% nel 2025, raggiungendo 14 milioni di unità e salendo a 43 milioni nel 2029.

Il mercato oggi è attualmente guidato dagli occhiali intelligenti (noti anche come occhiali AI), con una crescita del 250% nel 2025, eppure gli occhiali AR di prossima generazione sono dietro l'angolo. Da i Ray-Ban abilitati alla fotocamera e all'AI di Meta agli occhiali per display AR leggeri di XREAL, la categoria si sta spostando nell'uso quotidiano per milioni di persone.

Punti Chiave

- Gli occhiali intelligenti e AR stanno accelerando verso l'adozione mainstream, con previsioni di entrate globali che superano i 25-30 miliardi di dollari entro il 2030.

- Avanzamenti nei display, sensori e sistemi di alimentazione stanno guidando l'innovazione negli occhiali intelligenti basati su fotocamera e AI e l'evoluzione verso design AR leggeri con veri sovrapposizioni visive.

- Le innovazioni da fornitori come Sony, Qualcomm, Bosch e Renesas stanno rendendo gli occhiali più leggeri, più comodi e più capaci, trasformando gli occhiali nella prossima frontiera della tecnologia personale.

La Tecnologia Dentro la Montatura

A guidare questa crescita è una cascata di innovazioni nei componenti. Telecamere miniaturizzate e microfoni MEMS, display micro-OLED, IMU di precisione e batterie ad alta densità energetica sono stati tutti progettati per adattarsi all'interno di una montatura che non pesa più di un paio di occhiali da vista alla moda di tutti i giorni.

Ogni nuovo prodotto rappresenta un sofisticato equilibrio di ottica, termica, connettività e stile. Il risultato è un paio di occhiali che sembra familiare ma offre le capacità di calcolo un tempo riservate a potenti smartphone. Gli occhiali intelligenti e AR di oggi mostrano quanto l'innovazione dei componenti sia progredita, ed è facile immaginare quanto ancora possa e andrà oltre.

Gli Occhiali Intelligenti Diventano Mainstream

La generazione attuale di occhiali intelligenti privilegia la comunicazione, l'assistenza AI e la comodità hands-free rispetto alle visualizzazioni aumentate. Invece di proiettare grafiche, catturano immagini e video, trasmettono audio e si collegano ad assistenti AI in tempo reale. All'interno di quelle montature sottili si trova una collezione impressionante di parti.

Gli occhiali Ray-Ban Meta, ad esempio, funzionano con il chipset Qualcomm Snapdragon AR1 Gen 1, che è un silicio personalizzato ottimizzato per l'elaborazione di immagini compatte e la connettività a bassa latenza. Inoltre, questi occhiali intelligenti leader di mercato utilizzano una gamma di componenti impressionanti:

- SoC + ISP: i processori di segnale d'immagine doppi dell'AR1 gestiscono foto da 12 MP e video da 6 MP direttamente sul dispositivo, minimizzando calore e ritardi.

- Sottosistema audio: micro-altoparlanti open-ear e formazione di fasci microfoni MEMS Knowles – come il SPH1644LM4H1 – garantiscono chiamate chiare e in vivavoce.

- Rilevamento del movimento: un IMU Bosch BMI270 traccia il movimento della testa per la stabilizzazione e l'attivazione dei gesti.

- Batteria e indicatore di carburante: una batteria Li-ion a cella singola abbinata a TI’s bq27441 offre una previsione accurata del tempo di funzionamento.

I progettisti hanno inoltre risolto questioni chiave relative al comfort: distribuzione del peso, raffreddamento passivo e canali acustici trasparenti. Questi avanzamenti hanno reso gli occhiali intelligenti leggeri, alla moda, funzionali e pratici da indossare in pubblico.

Portando in Vita la Vista: Display e Ottica

Mentre oggi gli occhiali intelligenti basati su fotocamera e intelligenza artificiale stanno entrando nel mainstream, il prossimo confine è l'augmentazione visiva - occhiali AR che proiettano un'immagine digitale reale nel tuo campo visivo. Tra i dispositivi consumer, gli occhiali XREAL One Pro AR sono diventati un design di riferimento per ciò che è attualmente possibile. Utilizzano doppi pannelli micro-OLED Sony da 0,55 pollici con una risoluzione di 1080p/120 Hz, raggiungendo un campo visivo di 57 gradi con un contrasto vivido e una luminosità fino a 700 nit. Il motore ottico a prisma piatto della società piega efficientemente la luce, consentendogli di adattarsi all'interno di una montatura sottile.

I display micro-OLED rimangono il cavallo di battaglia degli occhiali AR moderni. Offrono colori ricchi, un eccellente contrasto e un'emissione termica gestibile, tutti aspetti critici per un dispositivo che si trova a pochi millimetri dagli occhi dell'utente. Il loro svantaggio è la luminosità; a piena intensità, faticano ancora contro la luce solare diretta.

Per superare questo limite e ottenere funzionalità all'aperto, gli sviluppatori si stanno rivolgendo all'ottica a guida d'onda. Questi sono gli strati trasparenti che guidano la luce e piegano le immagini proiettate nella vista dell'utente. Due principali approcci dominano:

- I waveguide riflettenti (Lumus, SCHOTT) utilizzano piccoli specchi per reindirizzare la luce con alta efficienza, rendendoli abbastanza luminosi per l'uso all'aperto.

- I waveguide diffrattivi (Dispelix, DigiLens) utilizzano reticoli nanostrutturati per combinare la luce rossa, verde e blu in un unico foglio sottile. Il risultato sono montature snelle e leggere.

Entrambi presentano compromessi. I tipi riflettenti offrono luminosità e basso "effetto luce sugli occhi" ma aggiungono qualche millimetro di spessore; i tipi diffrattivi sono più sottili ma possono perdere uniformità del colore ed efficienza. Nel frattempo, i microdisplay micro-LED – come il MicroLED AMμLED™ 0.13 Series MIPI microdisplay di JBD – promettono realtà aumentata leggibile alla luce del sole una volta che la produzione aumenterà nel 2026. Questo microdisplay offre un eccezionale 6.350 pixel per pollice (PPI), posizionandolo tra i microdisplay più piccoli e luminosi al mondo.

Calcolo e Rilevamento: Il Cervello e gli Occhi

Man mano che i display migliorano, l'infrastruttura di calcolo deve stare al passo. Molti sistemi AR di fascia alta si affidano ora ai chipset Qualcomm’s XR2 Gen 2 e XR2+ Gen 2, progettati per gestire fino a dieci telecamere contemporaneamente e il mapping spaziale in tempo reale.

Intorno a questi processori si sta sviluppando una costellazione crescente di sensori:

- gli IMU come il ST ISM330IS gestiscono il tracciamento del movimento e la stabilizzazione.

- Sensori come il Sony IMX560 SPAD ToF, abbinato all'illuminazione ams-OSRAM VCSEL per la rilevazione della profondità, vengono utilizzati per mappare l'ambiente circostante.

- Telecamere e moduli sensori d'immagine come il 5 MP OmniVision OV716 CIS si occupano della cattura rivolta verso l'esterno, del tracciamento degli occhi e del riconoscimento dei gesti.

Un singolo paio di occhiali AR può ora integrare più di otto sensori, tutti alimentando un flusso di dati sincronizzato che deve essere fuso in millisecondi. La latenza, e non la pura velocità di elaborazione, determina quanto l'esperienza sia naturale. Questa sfida ha spinto i fornitori di SoC a integrare hub sensoriali dedicati e core AI, sfumando il confine tra calcolo e percezione/sensing.

Alimentazione, Termiche e Connettività

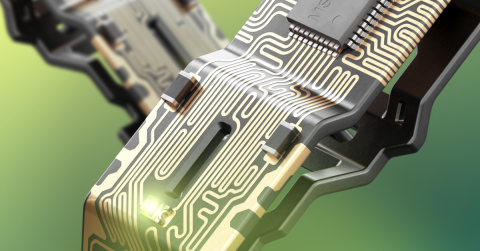

Non importa quanto siano capaci l'ottica o i processori, la gestione dell'energia determina ancora per quanto tempo questi dispositivi possono funzionare e quanto si sentono confortevoli. La maggior parte dei progetti utilizza una singola batteria agli ioni di litio divisa tra i due bracci delle aste, collegata da un nastro PCB flessibile.

Per allontanare il calore dalle aste, gli ingegneri si affidano a fogli di grafite Panasonic PGS e a cuscinetti GraphiteTIM (come EYGS182307), che conducono il calore lateralmente attraverso la montatura piuttosto che permettere che si accumuli vicino alle aste. La differenza tra 38°C e 43°C a contatto con la pelle è la differenza tra indossabile e non indossabile.

I moduli di connettività aggiungono la loro complessità. I moduli Murata Type 2FY e 2EA combinano Wi-Fi 6/7 e Bluetooth LE in pacchetti compatti e schermati. I controller companion, come i SoC BLE Renesas DA1470x, gestiscono gli input degli utenti, l'attivazione vocale e gli stati di alimentazione senza svegliare il processore principale. Anche il posizionamento dell'antenna è una danza attenta, condividendo spazio con altoparlanti, microfoni e aperture della fotocamera in pochi millimetri di plastica.

La prossima ondata di AR quotidiana

La linea tra occhiali intelligenti e occhiali AR sta iniziando a sfumare. La produzione di Guide d'Onda Riflettenti Geometriche di SCHOTT è aumentata nel 2025, e il recente rilascio dei nuovi Ray-Ban con display di Meta segnalano entrambi che la realtà aumentata per i consumatori è quasi pronta per il grande pubblico. I primi modelli enfatizzeranno dati consultabili rapidamente – inclusi sottotitoli, navigazione e notifiche – piuttosto che video completi o sovrapposizioni 3D, mantenendo budget energetici realistici.

Man mano che l'efficienza ottica migliora e la chimica delle batterie avanza, gli occhiali offriranno tempi di utilizzo più lunghi e una migliore leggibilità all'aperto senza sacrificare il design. Ciò che colpisce è quanto siano incrementali queste innovazioni: diffusori di grafite più sottili, microdisplay più luminosi e PMIC leggermente più intelligenti.

Per i progettisti hardware, questa convergenza significa più lavoro interdisciplinare: ingegneri ottici che collaborano con i team di layout PCB, sviluppatori firmware che ottimizzano i profili energetici per il comfort, responsabili degli approvvigionamenti che seguono i fornitori di guide d'onda come una volta seguivano le GPU.

Note dal Campo: Indossare il Futuro

Dopo mesi di utilizzo regolare, questi dispositivi sono diventati parte della mia routine quotidiana. Indosso i miei occhiali AI Meta Ray-Ban quasi tutti i giorni, camminando in giro per la città con un audiolibro o della musica che suona attraverso altoparlanti open-ear. Niente auricolari infilati nelle mie orecchie o visibili agli altri, nessuna disconnessione dal mondo intorno a me. Quando arriva un avviso di WhatsApp, gli occhiali sussurrano il messaggio nel mio orecchio, in modalità mani libere, mentre rimango concentrato sulla strada davanti a me o sul negoziante con cui sto chattando. Quando ho una domanda, la faccio in modo sommesso, come se stessi parlando da solo o con un amico AI nella mia testa, e ottengo una risposta all'istante. Sembra il futuro.

Gli occhiali sembrano montature eleganti da tutti i giorni, quindi la gente non si accorge che sto interagendo con la tecnologia, e mi dà l'impressione di operare sotto traccia.

Quando sono su voli lunghi, passo ai miei occhiali AR XREAL One Pro. Collegati al mio telefono o laptop tramite USB-C, mostrano una vista micro-OLED a grande schermo proprio davanti a me - quindi, invece di sentirmi come se fossi in una cabina di aereo angusta, mi sento come se fossi in un ampio e privato grande cinema. Questo, unito alle cuffie con cancellazione del rumore, rende un lungo volo in economica molto più sopportabile.

Queste esperienze personali sottolineano il principale traguardo tecnologico qui: l'hardware è finalmente diventato piccolo, fresco ed efficiente abbastanza da scomparire nelle montature di tutti i giorni, trasformando ciò che una volta richiedeva ingombranti cuffie in qualcosa di semplice come mettersi degli occhiali.

Una Nuova Forma Che Sembra Inevitabile

Gli occhiali smart e AR segnano la prossima fase del computing personale: ambientale, senza l'uso delle mani e integrato senza soluzione di continuità nella vita quotidiana. Invece di tirare fuori un dispositivo per interagire con le informazioni, viviamo accanto ad esse: facendo domande ad alta voce, ricevendo risposte nel nostro orecchio, vedendo il mondo aumentato in tempo reale. Man mano che i componenti diventano più piccoli, più intelligenti e più efficienti, gli occhiali dimostrano che la tecnologia più potente è quella che è presente quando serve e invisibile quando non serve.

Sia che tu stia costruendo elettronica di potenza affidabile o sistemi digitali avanzati per la prossima ondata di dispositivi intelligenti e AR, Altium Develop riunisce ogni disciplina in un ambiente collaborativo, libero da silos e limiti. Prova oggi Altium Develop per vedere come una piattaforma unificata aiuti ingegneri, progettisti e innovatori a co-creare senza vincoli.