Componentes por Trás dos Últimos Avanços em Óculos Inteligentes e de Realidade Aumentada

Dê uma olhada por dentro dos óculos inteligentes e de realidade aumentada (AR) de última geração para encontrar microdisplays, guias de onda, IMUs, sensores de profundidade, PMICs, resfriamento com grafite e conectividade compacta.

Óculos estão surgindo como o mais novo formato de dispositivo pessoal, mesclando moda, função e conectividade em um pacote elegante. De acordo com a IDC, espera-se que as remessas de óculos inteligentes e de realidade aumentada (AR) cresçam 39% em 2025, alcançando 14 milhões de unidades e subindo para 43 milhões em 2029.

O mercado hoje é atualmente impulsionado por óculos inteligentes (também conhecidos como óculos AI), com um crescimento de 250% em 2025, mas os óculos AR de próxima geração estão logo ali. Desde os Ray-Bans habilitados para câmera e AI da Meta até os óculos de exibição AR leves da XREAL, a categoria está avançando para o uso diário de milhões.

Principais Conclusões

- Óculos inteligentes e AR estão acelerando em direção à adoção mainstream, com previsões de receita global superando $25–30 bilhões até 2030.

- Avanços em displays, sensores e sistemas de energia estão impulsionando a inovação em óculos inteligentes baseados em câmera e AI e a evolução para designs AR leves com sobreposições visuais verdadeiras.

- Inovações de fornecedores como Sony, Qualcomm, Bosch e Renesas estão tornando os óculos mais leves, mais confortáveis e mais capazes, transformando os óculos na próxima fronteira da tecnologia pessoal.

A Tecnologia Dentro da Armação

Impulsionando esse crescimento está uma cascata de avanços em componentes. Câmeras miniaturas e microfones MEMS, displays micro-OLED, IMUs de precisão e baterias de alta densidade energética foram todos projetados para caber dentro de uma armação que não pesa mais do que um par de óculos estilosos do dia a dia.

Cada novo produto representa um sofisticado equilíbrio de óptica, térmicas, conectividade e estilo. O resultado são óculos que parecem familiares, mas oferecem o tipo de capacidades de computação antes reservadas para smartphones poderosos. Os óculos inteligentes e de realidade aumentada de hoje mostram o quão longe a inovação de componentes chegou, e é fácil imaginar o quanto mais longe pode e irá avançar.

Óculos Inteligentes se Tornam Populares

A geração atual de óculos inteligentes favorece a comunicação, assistência de IA e conveniência sem uso das mãos em vez de visuais aumentados. Em vez de projetar gráficos, eles capturam imagens e vídeos, transmitem áudio e se conectam a assistentes de IA em tempo real. Dentro dessas armações finas está uma impressionante coleção de peças.

Os óculos Ray-Ban Meta, por exemplo, funcionam com o chipset Qualcomm Snapdragon AR1 Gen 1, que é um silício personalizado otimizado para processamento de câmera compacta e conectividade de baixa latência. Além disso, esses óculos inteligentes líderes de mercado utilizam uma gama de componentes impressionantes:

- SoC + ISP: os processadores de sinal de imagem duplos do AR1 lidam com fotos de 12 MP e vídeos de 6 MP diretamente no dispositivo, minimizando calor e atraso.

- Sistema de áudio: micro-falantes de ouvido aberto e formação de feixe de microfones MEMS Knowles – como o SPH1644LM4H1 – proporcionam chamadas claras e mãos-livres.

- Sensor de movimento: um IMU Bosch BMI270 rastreia o movimento da cabeça para estabilização e gatilhos de gestos.

- Bateria e indicador de combustível: uma bateria de Li-ion de célula única emparelhada com o bq27441 da TI oferece previsão precisa do tempo de funcionamento.

Os designers também resolveram questões chave de conforto: distribuição de peso, resfriamento passivo e canais acústicos transparentes. Esses avanços tornaram os óculos inteligentes leves, elegantes, funcionais e práticos para usar em público.

Trazendo a Visão para a Vida: Displays e Óptica

Enquanto óculos inteligentes baseados em câmera e IA estão entrando no mainstream hoje, a próxima fronteira é a ampliação visual – óculos AR que projetam uma imagem digital verdadeira no seu campo de visão. Entre os dispositivos de consumo, os óculos XREAL One Pro AR tornaram-se um design de referência para o que é atualmente possível. Eles usam painéis micro-OLED Sony de 0,55 polegadas operando a 1080p/120 Hz, alcançando um campo de visão de 57 graus com contraste vívido e brilho de até 700 nits. O motor óptico de prisma plano da empresa dobra a luz de forma eficiente, permitindo que ele se encaixe em uma armação fina.

Os displays micro-OLED permanecem o cavalo de batalha dos óculos AR modernos. Eles entregam cores ricas, excelente contraste e saída térmica gerenciável, que são todos críticos para um dispositivo que fica a milímetros dos olhos do usuário. Seu ponto negativo é o brilho; na intensidade máxima, eles ainda lutam contra a luz solar direta.

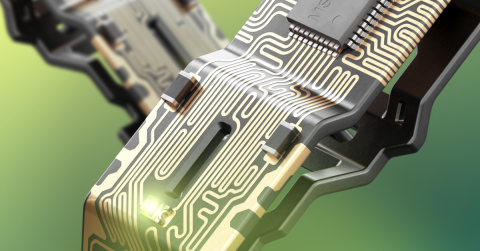

Para superar esse limite e alcançar funcionalidade ao ar livre, os desenvolvedores estão recorrendo à óptica de guia de onda. Estas são as camadas transparentes que guiam a luz que dobram as imagens projetadas para a visão do usuário. Duas abordagens principais dominam:

- Guias de onda reflexivos (Lumus, SCHOTT) utilizam pequenos espelhos para redirecionar a luz com alta eficiência, tornando-os suficientemente brilhantes para uso externo.

- Guias de onda difrativos (Dispelix, DigiLens) usam grades nanoestruturadas para combinar luz vermelha, verde e azul em uma única folha fina. O resultado são armações simplificadas e leves.

Ambos têm compensações. Os tipos reflexivos oferecem brilho e baixo "brilho ocular", mas adicionam alguns milímetros de espessura; os tipos difrativos são mais finos, mas podem perder uniformidade de cor e eficiência. Enquanto isso, microdisplays de micro-LED – como o MicroLED AMμLED™ 0.13 Series MIPI microdisplay da JBD – prometem AR legível sob luz solar assim que a produção escalar em 2026. Este microdisplay entrega um extraordinário 6.350 pixels por polegada (PPI), posicionando-o entre os microdisplays mais pequenos e brilhantes do mundo.

Computação e Sensoriamento: O Cérebro e os Olhos

À medida que os displays melhoram, a estrutura de computação deve acompanhar. Muitos sistemas de AR de alta qualidade agora dependem dos chipsets Qualcomm’s XR2 Gen 2 e XR2+ Gen 2, que são projetados para lidar com até dez câmeras simultâneas e mapeamento espacial em tempo real.

Ao redor desses processadores, há uma crescente constelação de sensores:

- IMUs como o ST ISM330IS gerenciam o rastreamento de movimento e a estabilização.

- Sensores como o Sony’s IMX560 SPAD ToF, emparelhado com a iluminação ams-OSRAM VCSEL para detecção de profundidade, são usados para mapear o ambiente.

- Câmeras e módulos de sensor de imagem como o 5 MP OmniVision OV716 CIS lidam com a captura voltada para o mundo, rastreamento ocular e reconhecimento de gestos.

Um único par de óculos AR pode agora integrar mais de oito sensores, todos alimentando um fluxo de dados sincronizado que deve ser fundido em milissegundos. A latência, e não a velocidade bruta de processamento, determina quão natural a experiência se sente. Esse desafio levou os fornecedores de SoC a integrar hubs de sensores dedicados e núcleos de IA, borrando a linha entre computação e percepção/sensoriamento.

Potência, Térmicas e Conectividade

Não importa quão capazes sejam as ópticas ou processadores, a gestão de energia ainda dita por quanto tempo esses dispositivos podem funcionar e quão confortáveis eles se sentem. A maioria dos designs utiliza uma bateria de Li-ion de célula única dividida entre os dois braços da armação, conectada por uma fita flexível de PCB.

Para afastar o calor da têmpora, os engenheiros contam com folhas de grafite Panasonic PGS e almofadas GraphiteTIM (como EYGS182307), que conduzem o calor lateralmente através da armação em vez de permitir que ele se acumule perto da têmpora. A diferença entre 38°C e 43°C no contato com a pele é a diferença entre ser usável e não usável.

Módulos de conectividade adicionam sua própria complexidade. Os módulos Murata Type 2FY e 2EA combinam Wi-Fi 6/7 e Bluetooth LE em pacotes compactos e blindados. Controladores companheiros, como os SoCs BLE Renesas DA1470x, gerenciam entradas de usuários, ativação por voz e estados de energia sem despertar o processador principal. Até mesmo o posicionamento da antena é uma dança cuidadosa, compartilhando espaço com alto-falantes, microfones e aberturas de câmera em apenas alguns milímetros de plástico.

A Próxima Onda de AR Cotidiano

A linha entre óculos inteligentes e óculos de realidade aumentada (AR) está começando a se confundir. A produção de Guias de Onda Reflexivos Geométricos da SCHOTT acelerou em 2025, e o lançamento recente dos novos Ray-Bans com display da Meta sinalizam que o AR para consumidores está quase pronto para o horário nobre. Os primeiros modelos enfatizarão dados visíveis rapidamente – incluindo legendas, navegação e notificações – em vez de vídeos completos ou sobreposições em 3D, mantendo orçamentos de energia realistas.

À medida que a eficiência óptica melhora e a química da bateria avança, os óculos oferecerão maior tempo de uso e melhor legibilidade ao ar livre sem sacrificar o design. O que é impressionante é o quão incrementais são esses avanços: espalhadores de grafite mais finos, microdisplays mais brilhantes e PMICs um pouco mais inteligentes.

Para os designers de hardware, essa convergência significa mais trabalho interdisciplinar: engenheiros ópticos colaborando com equipes de layout de PCB, desenvolvedores de firmware ajustando perfis de energia para conforto, gerentes de sourcing acompanhando fornecedores de guias de onda como uma vez acompanharam GPUs.

Notas do Campo: Vestindo o Futuro

Após meses de uso regular, esses dispositivos se tornaram parte da minha rotina diária. Eu uso meus óculos Meta Ray-Ban AI na maioria dos dias, andando pela cidade com um audiolivro ou música tocando através de alto-falantes de ouvido aberto. Sem fones de ouvido presos nos meus ouvidos ou visíveis para os outros, sem desconexão do mundo ao meu redor. Quando um alerta do WhatsApp soa, os óculos sussurram a mensagem no meu ouvido, mãos-livres, enquanto permaneço focado na rua à frente ou no comerciante com quem estou conversando. Quando tenho uma pergunta, eu a faço em voz baixa, como se estivesse falando comigo mesmo ou com um amigo AI na minha cabeça, e obtenho uma resposta instantaneamente. Parece o futuro.

Os óculos parecem armações estilosas do dia a dia, então as pessoas não percebem que estou interagindo com a tecnologia, e parece que estou operando sob o radar.

Quando estou em voos longos, eu troco pelos meus óculos AR XREAL One Pro. Conectados ao meu telefone ou laptop via USB-C, eles exibem uma visão de micro-OLED de tela grande bem à minha frente – então, em vez de me sentir como se estivesse em uma cabine de avião apertada, sinto como se estivesse em um cinema grande e privado. Isso, juntamente com fones de ouvido com cancelamento de ruído, torna um voo longo na classe econômica muito mais suportável.

Essas experiências pessoais sublinham a conquista tecnológica central aqui: o hardware finalmente se tornou pequeno, frio e eficiente o suficiente para desaparecer em armações do dia a dia, transformando o que antes exigia fones de ouvido volumosos em algo tão simples quanto colocar óculos.

Um Novo Formato Que Parece Inevitável

Óculos inteligentes e de AR marcam a próxima fase da computação pessoal: ambiente, mãos-livres e integrados de forma contínua à vida cotidiana. Em vez de tirar um dispositivo para interagir com informações, estamos vivendo ao lado dela: fazendo perguntas em voz alta, recebendo respostas no nosso ouvido, vendo o mundo aumentado em tempo real. À medida que os componentes ficam menores, mais inteligentes e mais eficientes, os óculos estão provando que a tecnologia mais poderosa é aquela que está presente quando necessário e invisível quando não.

Seja construindo eletrônicos de potência confiáveis ou sistemas digitais avançados para a próxima onda de dispositivos inteligentes e de realidade aumentada, o Altium Develop reúne todas as disciplinas em um ambiente colaborativo, livre de silos e limitações. Experimente o Altium Develop hoje para ver como uma plataforma unificada ajuda engenheiros, designers e inovadores a co-criar sem restrições.