Komponenty stojące za dzisiejszymi przełomowymi inteligentnymi okularami i okularami AR

Zajrzyj do wnętrza przełomowych inteligentnych okularów i okularów AR, aby znaleźć mikrowyświetlacze, światłowody, jednostki IMU, czujniki głębi, PMIC, chłodzenie grafitowe oraz kompaktowe połączenia.

Okulary stają się najnowszym osobistym urządzeniem, łączącym modę, funkcjonalność i łączność w jedną elegancką całość. Według IDC, dostawy inteligentnych okularów i okularów z rozszerzoną rzeczywistością (AR) mają wzrosnąć o 39% w 2025 roku, osiągając 14 milionów jednostek i wzrastać do 43 milionów w 2029 roku.

Rynek obecnie napędzany jest przez inteligentne okulary (znane również jako okulary AI), z 250% wzrostem w 2025 roku, jednak okulary AR nowej generacji są tuż za rogiem. Od okularów Ray-Ban od Meta z kamerą i AI po lekki wyświetlacz AR od XREAL, kategoria ta przenosi się do codziennego użytku milionów osób.

Kluczowe wnioski

- Inteligentne okulary i okulary AR przyspieszają w kierunku głównego nurtu adopcji, z prognozami globalnych przychodów przekraczającymi 25–30 miliardów dolarów do 2030 roku.

- Postępy w wyświetlaczach, czujnikach i systemach zasilania napędzają innowacje w inteligentnych okularach opartych na kamerze i AI oraz ewolucję do lekkich konstrukcji AR z prawdziwymi nakładkami wizualnymi.

- Przełomy od dostawców takich jak Sony, Qualcomm, Bosch i Renesas sprawiają, że okulary są lżejsze, wygodniejsze i bardziej zdolne, przekształcając okulary w następną granicę osobistej technologii.

Technologia wewnątrz ramki

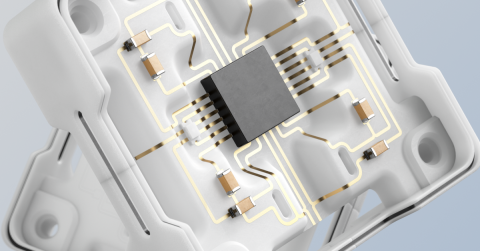

Napędzając ten wzrost jest kaskada przełomów w komponentach. Miniaturowe kamery i mikrofony MEMS, mikro-wyświetlacze OLED, precyzyjne jednostki IMU oraz baterie o dużej gęstości energii zostały zaprojektowane tak, aby zmieścić się w ramce, która waży nie więcej niż para codziennych, stylowych okularów.

Każdy nowy produkt reprezentuje wyrafinowaną równowagę optyki, termiki, łączności i stylu. Rezultatem są okulary, które wyglądają znajomo, ale oferują możliwości obliczeniowe, które kiedyś były zarezerwowane dla potężnych smartfonów. Dzisiejsze inteligentne okulary i okulary AR pokazują, jak daleko posunęła się innowacja komponentów i łatwo jest sobie wyobrazić, jak daleko jeszcze może i pójdzie.

Inteligentne Okulary Stają Się Popularne

Obecna generacja inteligentnych okularów faworyzuje komunikację, asystę AI i wygodę bez użycia rąk ponad wizualizacje rozszerzone. Zamiast projektować grafikę, rejestrują obrazy i wideo, transmitują dźwięk i łączą się z asystentami AI w czasie rzeczywistym. W tych smukłych ramkach znajduje się imponująca kolekcja części.

Na przykład okulary Ray-Ban Meta działają na chipsecie Qualcomm’s Snapdragon AR1 Gen 1, który jest specjalnie zaprojektowanym krzemem optymalizowanym pod kątem kompaktowej obróbki obrazu i łączności o niskim opóźnieniu. Ponadto, te wiodące na rynku inteligentne okulary wykorzystują szereg imponujących komponentów:

- SoC + ISP: podwójne procesory sygnałów obrazu AR1 obsługują zdjęcia 12 MP i filmy 6 MP bezpośrednio na urządzeniu, minimalizując ciepło i opóźnienia.

- Podsystem audio: otwarte mikrogłośniki i formujące wiązkę mikrofony MEMS Knowles – takie jak SPH1644LM4H1 – zapewniają czyste, wolne od użycia rąk rozmowy.

- Czujniki ruchu: IMU Bosch BMI270 śledzi ruchy głowy dla stabilizacji i wyzwalania gestów.

- Bateria i wskaźnik paliwa: pojedyncza bateria Li-ion w połączeniu z TI bq27441 dostarcza dokładne przewidywanie czasu pracy.

Projektanci rozwiązali również kluczowe problemy związane z komfortem: rozkład masy, pasywne chłodzenie i przezroczyste kanały akustyczne. Te postępy sprawiły, że inteligentne okulary są lekkie, modne, funkcjonalne i praktyczne do noszenia w miejscach publicznych.

Przybliżenie widoku do życia: Wyświetlacze i optyka

Podczas gdy okulary inteligentne oparte na kamerach i AI wchodzą obecnie do głównego nurtu, kolejnym etapem jest augmentacja wizualna – okulary AR, które projektują prawdziwy obraz cyfrowy w polu widzenia użytkownika. Wśród urządzeń konsumenckich, okulary XREAL One Pro AR stały się wzorcem tego, co jest obecnie możliwe. Wykorzystują one podwójne panele mikro-OLED firmy Sony o przekątnej 0,55 cala pracujące w rozdzielczości 1080p/120 Hz, osiągając kąt widzenia 57 stopni z żywym kontrastem i jasnością do 700 nitów. Silnik optyczny z płaskim pryzmatem firmy efektywnie składa światło, pozwalając na umieszczenie go w smukłej ramie.

Wyświetlacze mikro-OLED pozostają kluczowym elementem nowoczesnych okularów AR. Dostarczają one bogatej kolorystyki, doskonałego kontrastu i zarządzalnej emisji ciepła, co jest krytyczne dla urządzenia znajdującego się kilka milimetrów od oczu użytkownika. Ich wadą jest jasność; przy pełnej intensywności nadal mają trudności z bezpośrednim światłem słonecznym.

Aby przezwyciężyć ten limit i osiągnąć funkcjonalność na zewnątrz, deweloperzy zwracają się ku optyce falowodowej. Są to przezroczyste warstwy prowadzące światło, które zgina projektowane obrazy do pola widzenia użytkownika. Dwa główne podejścia dominują:

- Fale prowadzone odbiciowo (Lumus, SCHOTT) wykorzystują małe lusterka do skierowania światła z wysoką efektywnością, co czyni je wystarczająco jasnymi do użytku na zewnątrz.

- Fale prowadzone dyfrakcyjnie (Dispelix, DigiLens) używają nanostrukturalnych siatek dyfrakcyjnych do połączenia czerwonego, zielonego i niebieskiego światła w jedną cienką warstwę. Efektem są zgrabne, lekkie oprawki.

Oba typy mają swoje kompromisy. Typy odbiciowe oferują jasność i niski „blask oka”, ale dodają kilka milimetrów grubości; typy dyfrakcyjne są cieńsze, ale mogą tracić jednolitość kolorów i efektywność. Tymczasem mikrowyświetlacze micro-LED – takie jak JBD’s MicroLED AMμLED™ 0.13 Series MIPI mikrowyświetlacz – obiecują czytelność w świetle słonecznym dla AR, gdy produkcja osiągnie skalę w 2026 roku. Ten mikrowyświetlacz dostarcza niezwykłych 6,350 pikseli na cal (PPI), co umieszcza go wśród najmniejszych i najjaśniejszych mikrowyświetlaczy na świecie.

Obliczenia i Sensoryka: Mózg i Oczy

W miarę jak wyświetlacze się poprawiają, musi nadążyć za nimi komputerowe zaplecze. Wiele zaawansowanych systemów AR obecnie opiera się na chipsetach Qualcomm’s XR2 Gen 2 i XR2+ Gen 2, które są zaprojektowane do obsługi nawet dziesięciu równoczesnych kamer i mapowania przestrzennego w czasie rzeczywistym.

Wokół tych procesorów rośnie konstelacja czujników:

- IMU takie jak ST ISM330IS zarządzają śledzeniem ruchu i stabilizacją.

- Czujniki takie jak Sony’s IMX560 SPAD ToF, w połączeniu z oświetleniem ams-OSRAM VCSEL do wykrywania głębi, są używane do mapowania otoczenia.

- Kamery i moduły sensorów obrazu takie jak 5 MP OmniVision OV716 CIS zajmują się rejestrowaniem obrazu skierowanego na świat, śledzeniem ruchu oczu i rozpoznawaniem gestów.

Pojedyncza para okularów AR może teraz integrować więcej niż osiem czujników, wszystkie dostarczające zsynchronizowany strumień danych, który musi być połączony w ciągu milisekund. Latencja, a nie surowa prędkość przetwarzania, decyduje o tym, jak naturalne jest doświadczenie. To wyzwanie skłoniło dostawców SoC do integracji dedykowanych centrów sensorów i rdzeni AI, zacierając granicę między obliczeniami a czuciem/percepcją.

Moc, termika i łączność

Bez względu na to, jak zaawansowane są optyka czy procesory, zarządzanie energią nadal dyktuje, jak długo te urządzenia mogą pracować i jak komfortowo się je nosi. Większość projektów wykorzystuje pojedynczą baterię Li-ion podzieloną między obie ramiona okularów, połączoną elastyczną taśmą PCB.

Aby odprowadzić ciepło z okolicy skroni, inżynierowie polegają na grafitowych arkuszach Panasonic PGS oraz podkładkach GraphiteTIM (takich jak EYGS182307), które przewodzą ciepło bocznie przez ramę, zamiast pozwalać mu gromadzić się w pobliżu skroni. Różnica między 38°C a 43°C w kontakcie ze skórą to różnica między możliwością noszenia a niemożnością noszenia.

Moduły łączności dodają własną złożoność. Moduły Murata Type 2FY i 2EA łączą Wi-Fi 6/7 i Bluetooth LE w kompaktowych, ekranowanych opakowaniach. Towarzyszące kontrolery, takie jak SoC BLE Renesas DA1470x, zarządzają wejściami użytkownika, aktywacją głosową i stanami zasilania bez budzenia głównego procesora. Nawet umiejscowienie anteny to staranny taniec, dzielący przestrzeń z głośnikami, mikrofonami i otworami na aparat w zaledwie kilku milimetrach plastiku.

Następna fala codziennego AR

Granica między inteligentnymi okularami a okularami AR zaczyna się zacierać. Produkcja Geometrycznych Falowodów Odbiciowych SCHOTT została zwiększona w 2025 roku, a niedawne wprowadzenie na rynek nowych okularów Ray-Ban z wyświetlaczem od Meta oba sygnalizują, że konsumencki AR jest niemal gotowy na szczyt popularności. Najwcześniejsze modele będą podkreślać dane dostępne na pierwszy rzut oka – w tym napisy, nawigację i powiadomienia – zamiast pełnych wideo czy nakładek 3D, zachowując realistyczne budżety energetyczne.

W miarę jak efektywność optyczna się poprawia i chemia baterii postępuje, okulary będą oferować dłuższy czas noszenia i lepszą czytelność na zewnątrz, nie poświęcając przy tym designu. Co uderzające, jak inkrementalne są te przełomy: cieńsze rozpraszacze grafenu, jaśniejsze mikrowyświetlacze i nieco sprytniejsze PMIC.

Dla projektantów sprzętu, ta konwergencja oznacza więcej pracy międzydziedzinowej: inżynierowie optycy współpracujący z zespołami układu PCB, programiści firmware dostosowujący profile mocy dla komfortu, menedżerowie ds. zaopatrzenia śledzący dostawców falowodów tak, jak kiedyś śledzili GPU.

Notatki z terenu: Noszenie przyszłości

Po miesiącach regularnego użytkowania te urządzenia stały się częścią mojej codziennej rutyny. Noszę moje okulary AI Meta Ray-Ban większość dni, spacerując po mieście z audiobookiem lub muzyką odtwarzaną przez głośniki otwarte. Bez słuchawek dousznych w uszach czy widocznych dla innych, bez odłączania się od świata wokół mnie. Gdy przychodzi powiadomienie z WhatsApp, okulary szeptają mi wiadomość do ucha, pozwalając mi na bezręczne pozostanie skupionym na drodze przed sobą lub rozmowie ze sprzedawcą. Gdy mam pytanie, zadaję je cicho, jakbym rozmawiał sam ze sobą lub z przyjacielem AI w mojej głowie, i od razu otrzymuję odpowiedź. To czuje się jak przyszłość.

Okulary wyglądają jak stylowe, codzienne oprawki, więc ludzie nie zauważają, że wchodzę w interakcję z technologią, i mam wrażenie, że działam pod radarem.

Podczas długich lotów przełączam się na moje okulary AR XREAL One Pro. Podłączone do mojego telefonu lub laptopa przez USB-C, wyświetlają obraz z mikro-OLED na duży ekran tuż przede mną – więc, zamiast czuć się jak w ciasnej kabinie samolotu, czuję się jak w przestronnym, prywatnym kinie. To, w połączeniu ze słuchawkami z redukcją szumów, sprawia, że długi lot w ekonomicznej klasie jest znacznie bardziej znośny.

Te osobiste doświadczenia podkreślają centralne osiągnięcie technologiczne: sprzęt w końcu stał się na tyle mały, chłodny i wydajny, że znika w codziennych oprawkach, przekształcając to, co kiedyś wymagało nieporęcznych zestawów słuchawkowych, w coś tak prostego jak założenie okularów.

Nowy format, który wydaje się nieunikniony

Inteligentne okulary i okulary AR oznaczają następną fazę osobistego komputingu: otoczeniowy, wolne ręce i bezproblemowo zintegrowany z codziennym życiem. Zamiast wyciągać urządzenie, aby wchodzić w interakcję z informacjami, żyjemy obok nich: zadajemy pytania na głos, otrzymujemy odpowiedzi do ucha, widzimy świat wzbogacony w czasie rzeczywistym. W miarę jak komponenty stają się mniejsze, inteligentniejsze i bardziej wydajne, okulary udowadniają, że najpotężniejszą technologią jest ta, która jest obecna, gdy jest potrzebna i niewidoczna, gdy nie jest.

Czy budujesz niezawodne elektroniki mocy czy zaawansowane systemy cyfrowe dla kolejnej fali inteligentnych urządzeń i urządzeń AR, Altium Develop łączy wszystkie dyscypliny w jednym środowisku współpracy, wolnym od silosów i ograniczeń. Doświadcz Altium Develop już dziś, aby zobaczyć, jak zintegrowana platforma pomaga inżynierom, projektantom i innowatorom współtworzyć bez ograniczeń.