Como a IA Embarcada está Evoluindo em 2020 e Além

IA, aprendizado de máquina, IoT, computação de borda... a lista de termos da moda nas comunidades de hardware e software embarcado é longa, mas estes se destacam pois se tornaram mais comuns além dos desenvolvedores. O progresso em computação embarcada de propósito geral nos últimos ~10 anos é impressionante e chegou ao ponto em que posso implantar um dos nós de blockchain da minha empresa no meu bolso. A computação de propósito geral certamente percorreu um longo caminho e transformou a vida moderna.

E quanto à IA embarcada? Se olharmos para os avanços nas plataformas de computação para IA embarcada, certamente ficou atrás da computação embarcada de propósito geral. No passado recente, a IA embarcada não era realmente embarcada e dependia fortemente da nuvem. Uma nova classe de ASICs está prestes a mudar a dinâmica da IA embarcada, e os projetistas de hardware devem se preparar para construir sistemas em torno desses novos componentes. Aqui está o que está por vir no mundo da IA embarcada e como os novos sistemas embarcados podem tirar vantagem dessas mudanças.

Da Nuvem para a Borda

O sonho na IA embarcada é a computação eficiente em termos de energia na borda com hardware especializado. Os modelos de IA nesses dispositivos precisam ser treináveis, seja no nível do dispositivo ou na nuvem, o que exigiria então transmitir o modelo treinado de volta para a borda. Olhando para o passado recente e como a paisagem da IA evoluiu, vimos uma lenta transferência de capacidades de computação da nuvem para a borda.

Muito disso é auxiliado por plataformas de computação embarcada mais baratas e poderosas. Algo como um Raspberry Pi ou placa BeagleBone é poderoso o suficiente para fornecer previsão numérica ou classificação simples (por exemplo, imagens, texto ou áudio) no nível do dispositivo com modelos pré-treinados. No entanto, o treinamento no nível do dispositivo com essas plataformas leva uma quantidade significativa de tempo, assim o treinamento seria melhor realizado na nuvem. Novas plataformas de hardware específicas para IA estão tentando preencher essa lacuna e tiveram sucesso em acelerar a computação e habilitar tarefas mais avançadas. Um exemplo é a detecção de objetos combinada, reconhecimento facial e classificação de imagens a partir de dados de vídeo, que possibilita aplicações em segurança e automotivo, entre outros.

Progresso da IA embarcada da nuvem para a borda.

Google e NVIDIA têm estado em uma espécie de corrida armamentista recentemente para lançar plataformas de hardware especializadas para aplicações de IA embarcada. A unidade de processamento TensorFlow (TPU) do Google foi lançada como parte da plataforma de hardware Coral; esta plataforma é especializada para executar modelos TensorFlow no dispositivo. Isso a coloca mais próxima de uma verdadeira plataforma de IA embarcada específica para aplicações.

A plataforma Jetson da NVIDIA ainda se assemelha a uma plataforma de computação de propósito geral no que diz respeito ao uso de GPUs, mas o firmware é especializado para cálculos de IA no dispositivo. Atualmente, existem quatro opções especializadas em IA disponíveis pela NVIDIA que podem ser implementadas em aplicações embarcadas. Esses produtos da NVIDIA ainda consomem uma quantidade relativamente grande de energia e geram calor extremo, pois são construídos sobre a arquitetura de GPU legada, o que limita sua utilidade em produtos IoT menores.

Gargalos em IA Embarcada: Fique de Olho nos ICs Especializados em IA

O gargalo em IA embarcada não é um gargalo de processamento, é um gargalo de tamanho e calor. A capacidade de processamento de propósito geral existe, e os produtos GPU/TPU foram relegados a IA embarcada de propósito geral. Pense na Amazon Alexa; você não precisa de um processador específico para tarefas de IA embarcada, pois há muitas outras funções que o dispositivo precisa executar. Além disso, recebe energia constante da tomada e é projetado para estar constantemente conectado à internet. A gama de tarefas a serem realizadas por essa classe de sistemas embarcados é ampla o suficiente para que ICs especializados não sejam necessários.

Novos produtos IoT em aplicações e funções altamente específicas precisam de algo novo: um IC especializado em IA. Quando me refiro a um “IC especializado em IA”, não estou me referindo a uma GPU ou TPU. Em vez disso, estou me referindo a um IC com arquitetura de hardware especializada para executar tipos específicos de modelos de IA com menor consumo de energia e poucos ou nenhum periférico.

Startups de ICs sem fábrica estão se esforçando para preencher a lacuna com novas IPs que podem ser implementadas em outros produtos, ou com ICs independentes que fornecem capacidades de IA embarcada altamente específicas para aplicações. Uma empresa com a qual estou trabalhando está prestes a lançar um produto direcionado a 5G-IoT, robótica, Indústria 4.0 e outras áreas onde se espera que a IA embarcada domine.

Se você está construindo novos produtos IoT, robótica, produtos automotivos ou outros sistemas que precisam de capacidades de IA embarcada, fique de olho nos novos ICs especializados em IA com algumas das seguintes características:

- Treinamento no dispositivo: Este aspecto da IA embarcada ainda depende da capacidade de computação em nuvem, mas os melhores ICs especializados em IA permitirão treinamento no dispositivo, por exemplo, em aplicações de aprendizado supervisionado.

- Interfaces de alta velocidade: Obviamente, qualquer IC especializado em IA precisa se conectar com outros componentes em uma placa, e ele usará alguma interface de alta velocidade. I2C e SPI são interfaces ideais, embora eu esperasse que outras interfaces de alta velocidade fossem usadas para se conectar com periféricos de computador.

- Otimização para modelos de IA específicos: Modelos de IA/ML envolvem cálculos de matriz redundantes e etapas de otimização, e a arquitetura de hardware será projetada para executar os algoritmos envolvidos em diferentes modelos de IA/ML. Baixo consumo de energia: Chegar a níveis de potência sub-mW para cálculos de IA é crítico para treinamento persistente no dispositivo, classificação e previsão em aplicações de IA pesadas em dados. Uma arquitetura otimizada pode ajudar os designers a superar o gargalo de calor, o que também permite reduzir o tamanho geral de um novo produto.

Fechar o Círculo: Retornando ao Centro de Dados

Espero que novos ICs especializados e núcleos de IP sejam amplamente lançados nos próximos anos. Esta mudança do computador de propósito geral para hardware específico de aplicação é o que permitirá aplicações de IA embutida mais avançadas. Os OEMs poderão produzir dispositivos menores com maior eficiência computacional do que poderia ser fornecida por MCUs de propósito geral.

Eu tenho falado sobre IA embutida em termos do nível de borda, mas ICs especializados em IA podem facilmente filtrar de volta pela hierarquia de rede até o nível do centro de dados. Transferir estas tarefas de processadores de propósito geral para um ASIC reduzirá o consumo geral de energia no nível do centro de dados.

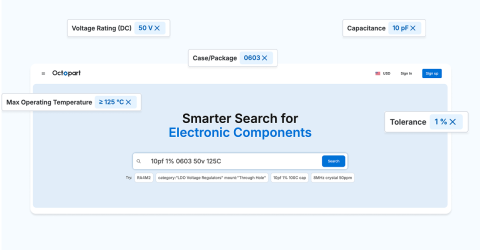

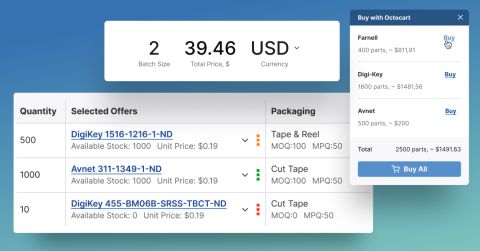

A paisagem eletrônica pode mudar rapidamente, e a IA embutida não é exceção. Se você está procurando pelos mais novos ASICs de IA embutida ou qualquer outro componente para um novo produto, Octopart estará aqui para ajudá-lo a encontrar os componentes de que precisa.

Mantenha-se atualizado com nossos últimos artigos ao assinar nossa newsletter.