Przyszłość zarządzania BOM: trendy i innowacje

Tradycyjny, statyczny BOM działa tylko wtedy, gdy podaż jest stabilna, ceny zmieniają się powoli, a zdarzenia związane z cyklem życia są przewidywalne, ale warunki te nie opisują już rynku elektroniki.

Na początku 2026 roku najwięksi producenci DRAM przekierowali moce produkcyjne wafli w stronę HBM i DDR5, aby sprostać popytowi napędzanemu przez AI, co ograniczyło podaż starszych rozwiązań. Według analiz TrendForce i Sourceability ceny kontraktowe DDR4 i innych konwencjonalnych pamięci DRAM wzrosły w 1Q26 o kilkadziesiąt procent — a w niektórych starszych segmentach nawet do 50% — podczas gdy lead time wydłużył się do ponad 20–30 tygodni.

W warunkach takiej zmienności statyczny BOM staje się obciążeniem, ukrywając ekspozycję finansową i ryzyko operacyjne zamiast je kontrolować.

Obecnie dynamika realokacji mocy produkcyjnych powoduje:

- Gwałtowne zmiany dostępności

- Nieliniowe skoki cen

- Krótsze okna reakcji

Brak śledzenia zmian cyklu życia – szczególnie w przypadku starszych pamięci, takich jak DDR4 zbliżających się do EOL – znacząco zwiększa ryzyko opóźnień produkcyjnych. Przewaga konkurencyjna przesunęła się z optymalizacji projektu na szybkość reakcji BOM. Zmianę tę wzmacnia efekt „utraty mocy produkcyjnych”: rozpoczęcia produkcji wafli przeznaczonych na HBM pochłaniają nieproporcjonalnie dużo zasobów produkcyjnych (konfiguracje o wysokim stosie wymagają nawet do 3x większej powierzchni wafla niż standardowy DRAM), co ogranicza produkcję standardowego DRAM nawet przy wysokim wykorzystaniu fabryk.

W rezultacie BOM ewoluuje w kierunku żywego, wysokoczęstotliwościowego frameworku decyzyjnego. Zarządzanie BOM nie jest już okresową walidacją, lecz ciągłą kontrolą opartą na danych. Najbardziej odporne organizacje traktują swój BOM jako czujnik działający w czasie rzeczywistym dla globalnego łańcucha dostaw. W takim środowisku optymalne okno na zabezpieczenie zapasów skurczyło się z tygodni do zaledwie godzin, ponieważ zautomatyzowane boty zakupowe natychmiast wykupują zapasy z globalnego rynku spot, gdy tylko pojawi się alert dotyczący cyklu życia.

Najważniejsze wnioski

- Statyczne BOM-y są obciążeniem w dzisiejszym niestabilnym łańcuchu dostaw. Dynamiczne zarządzanie BOM jest dziś wymogiem konkurencyjności.

- Narzędzia BOM oparte na AI są skuteczne tylko na tyle, na ile dobre są dane, które je zasilają. Czyste, uporządkowane dane są warunkiem wstępnym.

- Zintegrowane środowiska PLM-ERP-MES eliminują lukę opóźnień, która powoduje „ghost stock” i utratę okien sourcingowych.

- Deterministyczna automatyzacja zapewnia dziś wiarygodny ROI, jednocześnie budując fundament danych potrzebny AI do skalowania.

- Firmy, które już teraz standaryzują dane BOM, będą najlepiej przygotowane, by przetrwać kolejne zakłócenia podaży.

Dlaczego zarządzanie BOM musi ewoluować

Tradycyjne, ręczne podejście do zarządzania BOM załamuje się pod presją współczesnych cykli produkcyjnych.

Problem „ghost data”

Ręczne workflow generują znaczący margines błędu, prowadząc do „ghost stock”, czyli sytuacji, w której części wydają się dostępne na papierze, ale fizycznie ich brakuje. W realiach 2026 roku, gdy kluczowe komponenty coraz częściej przechodzą na model zamówień wyłącznie w ramach alokacji, a dystrybutorzy priorytetowo traktują klientów kontraktowych, ghost stock może mieć katastrofalne skutki.

Imperatyw transformacji

Badania sektora produkcyjnego pokazują szybkie wdrażanie platform cyfrowych w celu zarządzania krótszymi cyklami innowacji i przyspieszenia Engineering Change Orders (ECO). Skracanie time-to-market stało się kluczowym wskaźnikiem efektywności. Ponieważ cykle technologiczne w elektronice użytkowej i motoryzacji mierzy się dziś miesiącami, a nie latami, czas tracony na ręczne aktualizowanie arkusza kalkulacyjnego po zmianie jednego kondensatora może kosztować firmę utratę przewagi pierwszego gracza na rynku.

Najpierw fundamenty

Sukces w 2026 roku wymaga przeniesienia BOM-ów do połączonych środowisk, aby wyeliminować opóźnienia danych przed wdrożeniem zaawansowanej automatyzacji. Zanim organizacja będzie mogła mówić o gotowości na AI, musi najpierw rozwiązać problem luki opóźnień między działem inżynieryjnym a magazynem.

BOM jako źródło prawdy

Aby osiągnąć odporność, BOM musi stać się ostatecznym źródłem prawdy w całej organizacji, łącząc projektowanie, sourcing i produkcję.

Integracja systemów

Zastąpienie arkuszy kalkulacyjnych zintegrowanymi środowiskami PLM-ERP-MES synchronizuje widoki EBOM i MBOM, jednocześnie eliminując ręczne ponowne wprowadzanie danych. Inżynierowie i zespoły zakupowe pracują na wspólnym zbiorze danych obejmującym ceny, dostępność i status cyklu życia, co zapobiega kosztownym rozbieżnościom, gdy komponenty zatwierdzone na etapie projektu okazują się niedostępne, objęte ograniczeniami lub ekonomicznie nieopłacalne na etapie sourcingu.

Szybkość i ROI zapasów

Zintegrowane backbone’y zapewniają znaczącą poprawę time-to-market oraz mniej braków magazynowych dzięki powiązaniu aktualnego popytu z danymi inżynieryjnymi. Wykorzystując najnowsze połączenia z danymi magazynowymi, firmy zmierzają w stronę planowania ciągłego, w którym BOM działa jak czujnik łańcucha dostaw, uruchamiając alerty w momencie, gdy 12-miesięczna linia trendu komponentu wskazuje na prognozowany niedobór.

Wbudowana zgodność

Połączone BOM-y zapewniają identyfikowalność na poziomie komponentu w zakresie RoHS, REACH i ESG, zamieniając zgodność z przepisami w proaktywne ograniczenie projektowe, a nie kontrolę na późniejszym etapie. W związku z tym, że wysokiego ryzyka obowiązki AI wynikające z unijnego AI Act będą wdrażane etapami w latach 2026–2027, a standardy raportowania ESG stają się coraz bardziej rygorystyczne, nowoczesne BOM-y dla produktów przeznaczonych na rynek UE coraz częściej uwzględniają atrybuty w stylu Digital Product Passport, śledząc ślad węglowy i etyczność pracy dla każdej pozycji, aby zapewnić zgodność jeszcze przed zbudowaniem pierwszego prototypu.

Trendy AI w BOM a praktyczna rzeczywistość

Jak AI i uczenie maszynowe zmieniają workflow BOM

- Predykcyjne ocenianie ryzyka i niedoborów: Modele AI analizują wskaźniki ryzyka dostawców i trendy rynkowe, aby przewidywać wydłużenie lead time oraz ryzyko niedoborów z wyprzedzeniem 90–180 dni. W 2026 roku modele te coraz częściej uwzględniają także nietradycyjne dane, takie jak zatory portowe i geopolityczne zapowiedzi ceł.

- Inteligentne sugestie zamienników: Silniki oparte na ML wykraczają poza proste dopasowanie parametryczne i proponują zamienniki form-fit-function. W 2026 roku silniki te potrafią oceniać zamienniki zgodne z firmware, sugerując zmianę MCU, która nie wymaga całkowitego przepisywania oprogramowania.

- Wykrywanie anomalii: Uczenie maszynowe identyfikuje dryf BOM, wykrywając błędne wartości napięcia, niezgodności obudów lub nagłe skoki cen. Działa to jako zautomatyzowana kontrola zdroworozsądkowa, wychwytująca ludzki błąd, taki jak pomyłka w miejscu dziesiętnym wartości napięcia, zanim trafi on na linię montażu PCB.

- Semantyczne wyszukiwanie części: Przetwarzanie języka naturalnego pozwala inżynierom przeszukiwać biblioteki koncepcyjnie (np. „moduł BLE o ultra niskim poborze mocy do przemysłowego IoT”). Eliminuje to silosy słów kluczowych, przez które inżynier mógłby przeoczyć lepszą część tylko dlatego, że została sklasyfikowana według innej konwencji nazewniczej.

Luka gotowości na AI: dlaczego najpierw potrzebne są czyste dane

Ryzyko halucynacji nadal stanowi wyzwanie dla wczesnych wdrożeń AI. Wczesne implementacje AI w elektronice często cierpią z powodu probabilistycznych halucynacji, gdy modele sugerują nieistniejące numery części lub niekompatybilne zamienniki z powodu niepełnych danych treningowych. W środowisku produkcyjnym nawet model o wysokiej dokładności staje się problematyczny, jeśli pojedyncze błędy prowadzą do problemów z dostawami, kwalifikacją lub niezawodnością.

Ta zmiana jest już widoczna. Globalny rynek łańcucha dostaw wspieranego przez AI — już w 2026 roku sektor wart ponad 10 miliardów dolarów — przyspiesza w kierunku oczekiwanej wyceny 50,41 miliarda dolarów, napędzany właśnie przez wyspecjalizowanych agentów zadaniowych, którzy przekształcają workflow BOM. Chociaż analitycy prognozują szybki wzrost wyspecjalizowanych agentów AI, systemy te są skuteczne tylko na tyle, na ile dobre są dane, które konsumują. Ich skuteczność jest fundamentalnie ograniczona integralnością danych, a więc jakością, strukturą i kompletnością wejść.

W tym roku uporządkowanej gotowości producenci priorytetowo traktują normalizację danych, łączenie silosów danych oraz standaryzację BOM. Czynnikiem ograniczającym nie są już możliwości modeli, lecz jakość danych. Rozproszone BOM-y oparte na arkuszach kalkulacyjnych nie mogą wiarygodnie wspierać podejmowania decyzji napędzanego przez AI, a źle ustrukturyzowane dane wejściowe grożą przekształceniem inteligentnej automatyzacji w źródło niepewności operacyjnej.

Deterministyczna automatyzacja: wiarygodna wartość już dziś

Zanim AI zacznie „myśleć”, narzędzia BOM muszą zacząć „weryfikować”. Kontrole deterministyczne — egzekwowanie AVL, wykrywanie duplikatów części, walidacja jednostek — zapewniają natychmiastowy, mierzalny ROI bez niepewności właściwej modelom probabilistycznym. W 2026 roku deterministyczna automatyzacja pełni funkcję arbitra: każda sugestia wygenerowana przez AI jest oceniana względem twardych reguł inżynieryjnych, zanim zostanie zatwierdzona.

Opierając workflow na deterministycznej dokładności, Octopart dostarcza warstwę danych o wysokiej wierności: czyste metadane części, autorytatywne rekordy producentów i scentralizowany kontekst historyczny, od którego systemy AI będą ostatecznie zależeć, aby skutecznie się skalować. Octopart ustanawia źródło prawdy wymagane przez nowoczesne łańcuchy dostaw, zapewniając, że każde dopasowanie jest oparte na zweryfikowanych danych, a nie na wnioskowaniu statystycznym.

Możliwości narzędzi BOM nowej generacji

Nowoczesne narzędzie BOM nie jest już tylko przeglądarką, lecz aktywnym silnikiem diagnostycznym.

- Normalizacja: Zautomatyzowany import z systemów EDA/PLM zapewnia standaryzację numerów części producenta (MPN), eliminując problem myślników, w którym „Part-123” i „Part 123” są traktowane jako dwa różne elementy.

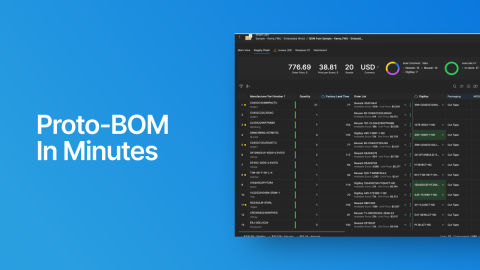

- Aktualna inteligencja danych: Bezpośrednie połączenia z najnowszymi danymi o dostępności i statusie cyklu życia ujawniają ryzyka NRND/EOL na wiele miesięcy przed tym, zanim dotrą one do linii produkcyjnej. Na przykład w Octopart można zobaczyć oznaczoną kolorami ocenę ryzyka dla każdej pozycji BOM na podstawie globalnych poziomów zapasów i roadmap producentów.

- Dopasowanie deterministyczne: Tam, gdzie generatywna AI może halucynować lub błędnie dopasowywać części, deterministyczne silniki dopasowujące, takie jak Octopart, działają na podstawie wyselekcjonowanej, zweryfikowanej bazy danych komponentów. Zapewnia to wiarygodne ceny od wielu dystrybutorów, zweryfikowane zamienniki oraz dokładne powiązania z producentami. To „praktyczna AI”, która działa już dziś, automatyzując żmudne zadania dopasowywania i porównywania cen bez ryzyka błędów generowanych przez AI.

Rekomendacje dla strategii BOM na 2026 rok

Po pierwsze, standaryzacja. Przeprowadź audyt silosów arkuszy kalkulacyjnych i nadaj priorytet przejściu do połączonego środowiska. Higiena danych to najlepsza obrona przed zmiennością roku 2026.

Zawsze korzystaj z najnowszych danych. Wdróż progi zgodności i cyklu życia na poziomie BOM. Używaj alertów do zarządzania regionalnymi zmianami taryf w 2026 roku — takimi jak 25% cła Section 232 na zaawansowane półprzewodniki AI i ich pochodne, obowiązujące od 15 stycznia 2026 roku — które mogą z dnia na dzień istotnie zmienić całkowity koszt dostarczenia BOM. Dla globalnych producentów elektroniki różnica między rentowną serią a produkcją poniżej kosztów zależy dziś od zdolności do ponownej symulacji kosztów BOM względem nowych ogłoszeń handlowych w ciągu minut, a nie miesięcy.

I wreszcie, co nie mniej ważne, przeprowadź pilotaż pod kątem ROI. Wykorzystaj Octopart BOM Tool w aktywnym projekcie NPI. Porównaj czas ręcznego sourcingu z ostatniego projektu ze zautomatyzowanym przepływem pracy opartym na Octopart, aby potwierdzić biznesowe uzasadnienie pełnego wdrożenia cyfrowego.

Czyste dane to nowe złoto

Przyszłość zarządzania BOM-em nie opiera się na magicznym przycisku AI, lecz na połączonym potoku danych. Octopart zapewnia praktyczną odporność potrzebną do radzenia sobie ze zmiennością roku 2026, jednocześnie budując zweryfikowany fundament danych wymagany dla autonomicznych przepływów pracy AI jutra. W erze automatyzacji przetrwają te firmy, które mają najczystsze dane i najszybsze narzędzia do działania na ich podstawie, gdy nadejdzie kolejny kryzys na rynku pamięci.

Chcesz zautomatyzować normalizację danych, śledzenie cyklu życia i analizę sourcingu? Wypróbuj Octopart BOM Tool już dziś.